今日头条内容安全机制曝光:人工审核+技术识别

日前,今日头条召开了“让算法公开透明”分享交流会。资深算法架构师、中国科学技术大学计算机博士曹欢欢在会上重点讲解了今日头条的内容安全机制及相关举措,首次公开了风险内容识别技术以及泛低质内容识别技术。

曹欢欢指出,“头条现在拥有健全的内容安全机制。除了人工审核团队,我们还有技术识别。包括风险内容识别技术,构建千万张图片样本集的鉴黄模型,超过百万样本库的低俗模型和谩骂模型等,以及泛低质内容识别技术。”

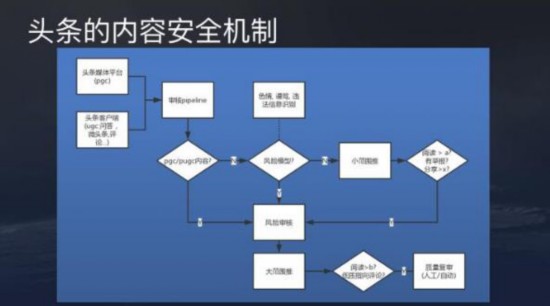

具体而言,头条的内容来自两部分,一部分是PGC平台,另外一部分UGC内容比如问答、用户评论、微头条,这两部分内容是用共同的审核机制,这一套机制在国内也很完善。

“如果PGC内容相对比较靠谱会有一个风险模型的过滤,如果这里面有可能有问题,会做色情谩骂、非法信息的识别,先审核,没问题先小范围推广,搜集用户反馈,比如举报,用户分享数阅读数比较大,我们会再次进入二次推荐审核,如果不是的话,我们就会直接进入很严格的分级审核,审核之后再大范围推广。”曹欢欢表示。

他进一步提到,“大范围推广还有一道把关,如果用户阅读数再大特别热或者有一些评论有问题,我们也会进入最后一道质量复审,直接下架。整个机制比较健全,但是整个内容增长和业务发展非常快,还有各种评论UGC内容也要做内容安全的控制,这个团队压力比较大。“

对于运用的技术手段,曹欢欢解释说,有鉴黄模型,低俗模型,谩骂模型,用头条和竞品会发现,头条做了很多干预工作,如果用户经常出言不讳或者不当的评论,我们有一些惩罚机制。

“泛低质识别这部分的情况非常多,比如编造的内容、假新闻、黑稿、题文不符、有头无尾,看着说的很厉害,后来写了那么多也没有对应开始提出的悬念。对技术来讲,本身机器去理解是非常难的,这部分需要大量的反馈信息,比如用户的反馈,包括跟互联网抓取其它信息进行比对。目前低质模型的准确率不是特别高,召回率也不是特别高,这块要结合人工复审,需要把阈值提高。”曹欢欢表示。

此外,曹欢欢还在现场分享了今日头条推荐算法的基本原理,并详细介绍了算法模型设计维度与策略。包括如何在线训练大规模推荐模型,典型召回策略的设计方法,多目标如何融合等核心问题。

他表示:“算法分发并非是把所有决策都交给机器,我们会不断纠偏,设计、监督并管理算法模型。希望这次分享能让更多的人理解算法,并共同参与到算法模型的制定中来,以改善算法,更好的为用户服务,让算法为社会创造更大的价值。”

会议由今日头条副总编辑徐一龙主持。徐一龙在谈到今日头条对行业公开、透明自己算法原理的初衷时说,算法也是一种“法”,都是通过一定的规则和方法,达成预期的一种效果。算法和法律法规一样,如果施行的好,都很高效,也都要求透明。

分享让更多人看到

相关新闻

- 评论

- 关注

第一时间为您推送权威资讯

第一时间为您推送权威资讯

报道全球 传播中国

报道全球 传播中国

关注人民网,传播正能量

关注人民网,传播正能量